最近話題のバイブコーディング、直感で開発できてマジで最高ですよね!

でも「セキュリティとか大丈夫そ?」

って不安になるのもガチで分かります。

AI任せだと、脆弱性や情報漏洩のリスクも実はめっちゃ潜んでるんです。

そこで今回は、2026年版の安全な対策術を大公開!

この記事を読めば、リスクを抑えつつバイブコーディングを爆速で使い倒す方法がバッチリわかっちゃいますよ!

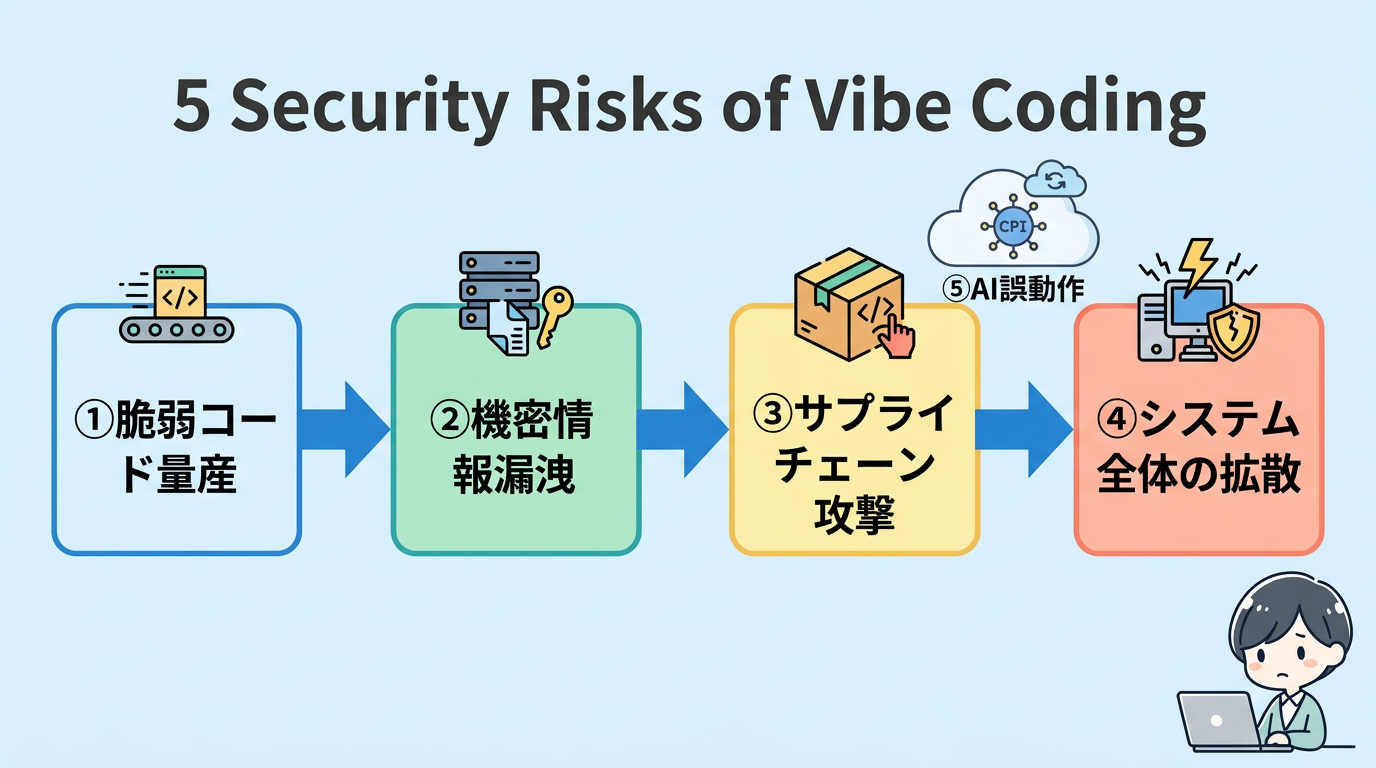

バイブコーディングのセキュリティリスク5つ

ヒナキラ

ヒナキラ「雰囲気」で動いちゃうからこそ、裏側のリスクにはガチで注意が必要なんです!

バイブコーディングって、直感的にアプリが作れて最高に楽しいですよね。

でも、2026年現在はその「手軽さ」の裏でセキュリティリスクが爆発的に増えています。

【用語解説】バイブコーディングとは、厳密な設計よりもAIへの指示(バイブス)と対話を重視して、爆速でコードを生成する開発手法のことです。

①脆弱性コードの量産リスク

AIは「動くコード」を作るのは得意ですが、それが「安全なコード」である保証はありません。

実際、ニューヨーク大学(NYU)等の研究では、AI生成コードの約40%に脆弱性が含まれていたという衝撃の結果が出ています。

人間が中身を理解せずに「Accept All(すべて承認)」を繰り返すと、気づかないうちに穴だらけのシステムが完成してしまうんです。

パロアルトネットワークスの調査でも、サイバー攻撃が1年前の4倍に急増しているというデータがあり、まさに「脆弱性の量産」が現実の脅威になっています。

②機密情報の漏洩とAPI露出

バイブコーディングに夢中になっていると、ついついやってしまうのが機密情報の混入です。

AIエージェントに環境構築を丸投げした結果、APIキーやパスワードがコード内にハードコード(直書き)されるケースが後を絶ちません。

そのままGitHubなどの公開リポジトリにプッシュしてしまい、数分で情報を盗まれる……なんて事態も珍しくないんです。

2026年3月にGitHubが「AgentHQ」を発表し、AIによる機密情報スキャンを強化したのも、このリスクが深刻化しているからなんですね。

③パッケージ捏造のサプライチェーン攻撃

これ、ぶっちゃけ一番怖いリスクかもしれません。

AIが「ハルシネーション(もっともらしい嘘)」を起こして、実在しないライブラリの使用を提案することがあります。

攻撃者はその「存在しない名前」を先回りして登録し、悪意あるコードを仕込んだパッケージを配布するんです。

これを「AIパッケージ・ハルシネーション」と呼び、IPA(情報処理推進機構)も供給網攻撃の新たな手口として強く警戒を呼びかけています。

④MCPプロトコルの脆弱性とRCE

2026年の最新トレンドとして無視できないのが、MCP(Model Context Protocol)を狙った攻撃です。

CursorやClaude Codeなどで使われるこの仕組みですが、悪意のある設定ファイルを読み込ませることで遠隔操作(RCE)を許してしまうリスクが見つかっています。

「MCPoison」と呼ばれる攻撃手法では、認証なしの公開サーバーを介してAIエージェントが乗っ取られる危険性が指摘されています。

便利すぎるツールには、それ相応の「裏口」のリスクが潜んでいることを忘れてはいけません。

【用語解説】RCE(Remote Code Execution)とは、攻撃者が遠隔地からターゲットのコンピュータ上で任意のコマンドを実行できてしまう、極めて危険な脆弱性のことです。

⑤AIエージェントの権限悪用と誤動作

最近のAIは、コードを書くだけじゃなく、ターミナルでコマンドを実行したりブラウザを操作したりもしますよね。

この「自律的な行動」が、設定ミスやプロンプト注入(悪意ある指示)によって暴走するリスクがあります。

OWASP(Open Worldwide Application Security Project)も、2025年版の指針で「過剰なエージェンシー」を重大なリスクとして定義しました。

AIに与える権限は必要最小限に絞っておかないと、勝手にファイルを削除されたりデータを外部に送信されたりするかもしれません。

- AI生成コードの約4割に脆弱性が潜んでいる

- 機密情報のハードコードによる漏洩が多発

- 存在しないライブラリを狙った「待ち伏せ型」攻撃

- MCPプロトコルを悪用した遠隔操作(RCE)の脅威

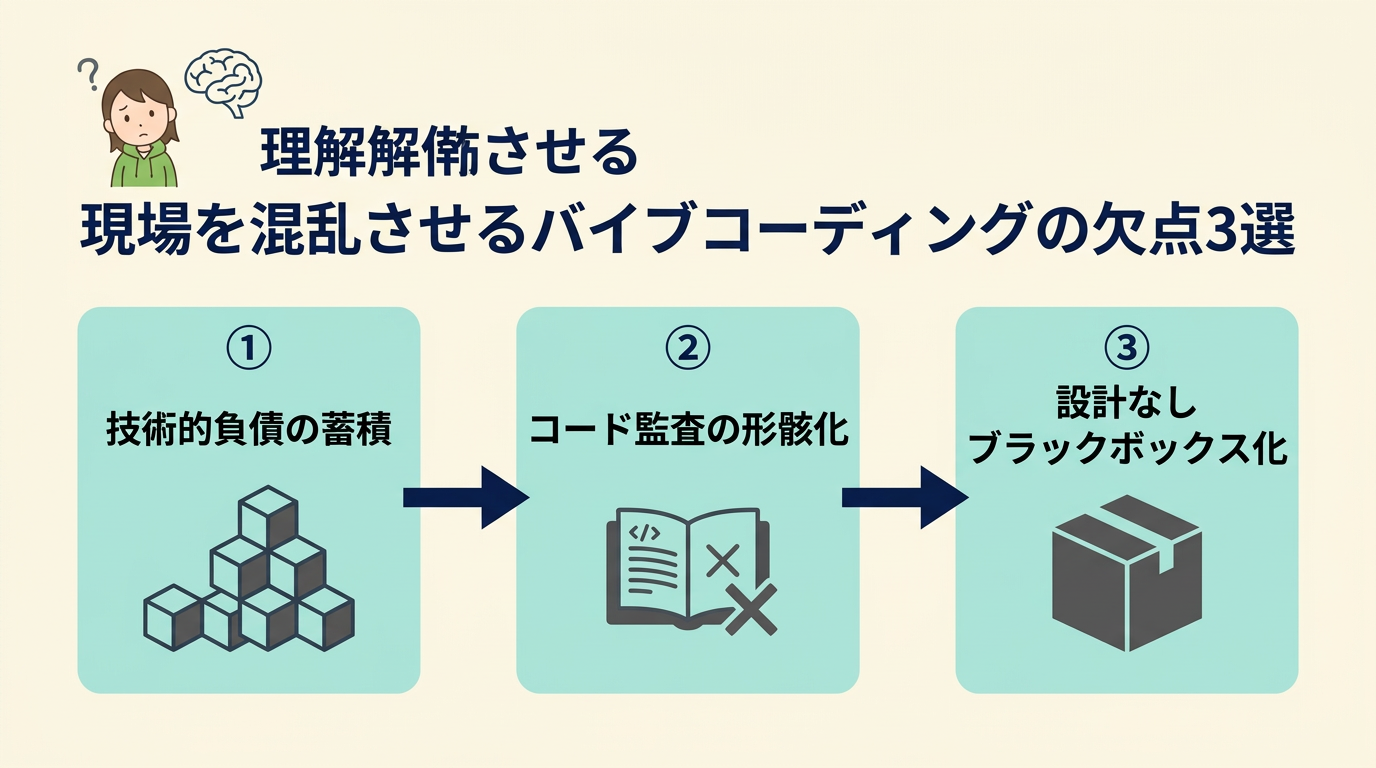

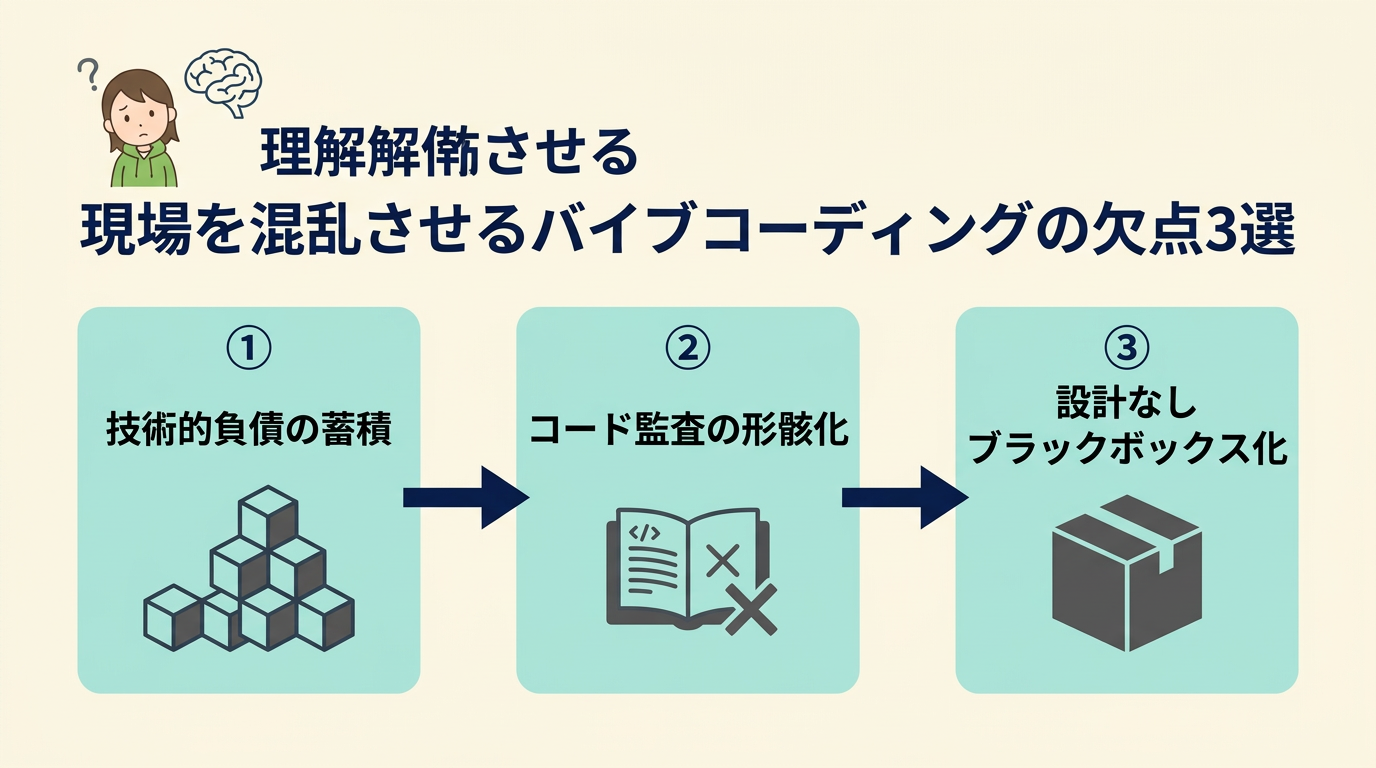

現場を混乱させるバイブコーディングの欠点3選

勢いだけで突き進むと、後で「修羅場」が待っているかも……!?

①深刻な技術的負債の蓄積

バイブコーディングは「今この瞬間」を動かすには最強ですが、将来のメンテナンス性は置き去りになりがちです。

AIが生成したスパゲッティコードが積み重なると、修正や機能追加が不可能になる「技術的負債」が爆速で溜まっていきます。

「自分でも何が書いてあるか分からないけど動いている」という状態は、まさに爆弾を抱えて走っているようなもの。

後からエンジニアが泣きながらリファクタリング(整理)する羽目になるのは、バイブコーディングあるあるです。

②人間によるコード監査の形骸化

人間がレビューできる量を遥かに超えるコードが、AIによって秒速で生成されるのが今の現場です。

パロアルトネットワークスの報告によれば、99%の組織が「レビューが追いつかない」という問題に直面しています。

結果として、内容を見ずに「LGTM(良さそうだね)」とボタンを押すだけの「監査の形骸化」が起きています。

Black Duckのレポートでは、これを「正しさの錯覚」と呼び、開発者の76%がAIコードを人間より安全だと誤認している実態を指摘しています。

③設計思想の欠如とブラックボックス化

バイブコーディングでは、全体像を描かずに部分的な指示を繰り返すため、一貫した設計思想が失われがちです。

機能ごとにバラバラなロジックが組み合わさり、システム全体が巨大なブラックボックスと化してしまいます。

不具合が起きたときに「なぜそうなったのか」を誰も説明できない状況は、エンタープライズ開発では致命的です。

これを防ぐために、2026年は単なるコード生成から、人間が設計と評価をしっかり握る「エージェンティックエンジニアリング」へのシフトが推奨されています。

【用語解説】エージェンティックエンジニアリングとは、人間が上位の設計を行い、複数のAIエージェントを指揮・統制して高品質なシステムを構築する概念のことです。

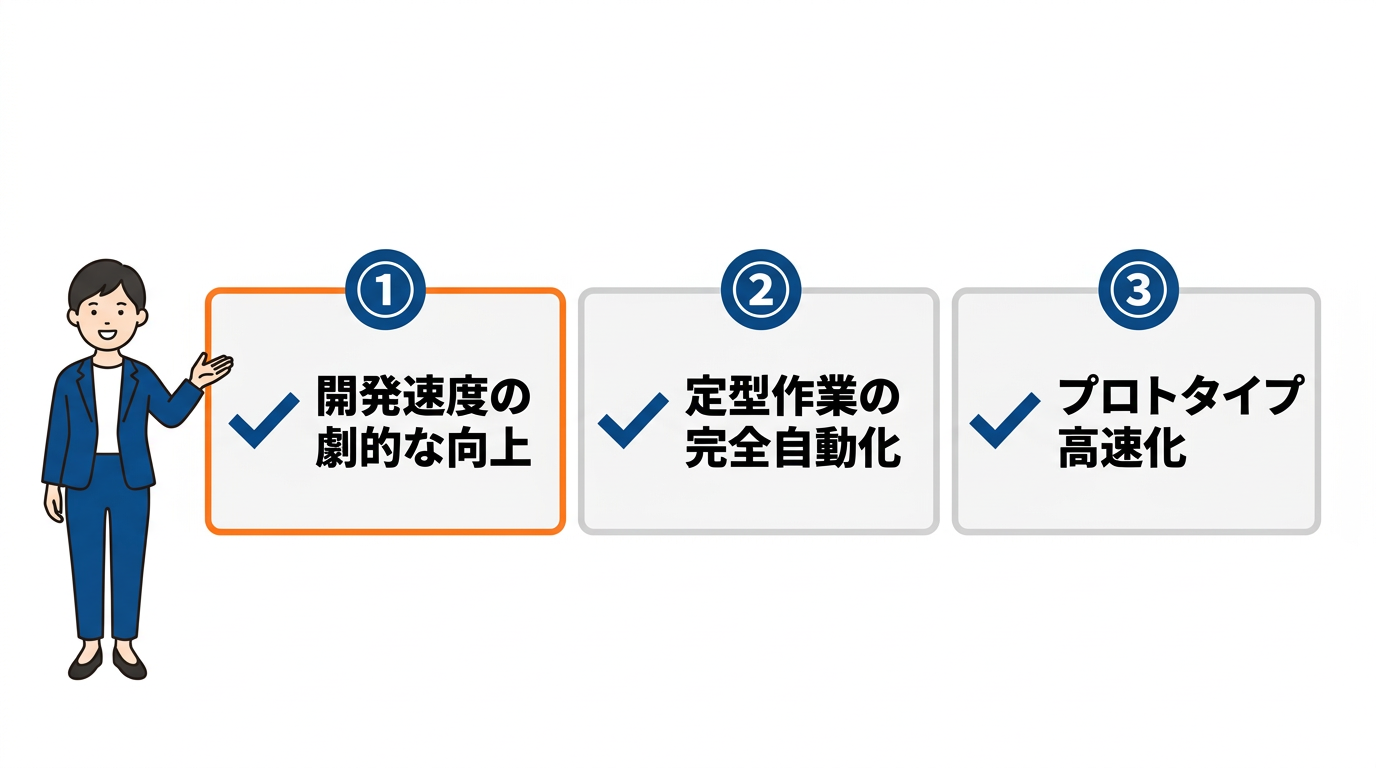

安全にバイブコーディングを運用するメリット3つ

リスクはあるけど、正しく使えばマジで「神」ツールなんです!

①開発速度の劇的な向上

なんと言っても、バイブコーディング最大の魅力は「思考の速度で形になる」ことですよね。

これまでは数日かかっていた環境構築やボイラープレート(定型コード)の作成が、AIなら数秒で終わります。

この爆速感は一度味わうと、正直もう以前の開発スタイルには戻れません。

セキュリティを担保しつつこのスピードを維持できれば、競合他社を圧倒するプロダクト開発が可能になります。

②反復的な定型作業の完全自動化

テストコードの作成やドキュメントの整備といった、人間が「ちょっと面倒だな」と思う作業はAIの得意分野です。

バイブコーディングのワークフローにこれらを組み込めば、開発者はよりクリエイティブな「設計」に集中できます。

Veracodeのレポートでも、AIによるテストの自動化がコード品質の底上げに寄与していることが示唆されています。

「やりたくない作業」をAIに任せて、自分はワクワクする機能開発に没頭できるなんて、最高じゃないですか?

③プロトタイプ検証サイクルの高速化

「とりあえず動くものを作って試す」というプロトタイピングにおいて、バイブコーディングは無双します。

アイデアをその日のうちに形にして、ユーザーのフィードバックを受けるサイクルを爆速で回せます。

MetaがAIエージェント企業のManusを20億ドルで買収したのも、この自律的な開発プロセスの価値を認めているからです。

「失敗してもすぐ直せる」という柔軟性が、2026年の不確実なビジネス環境では大きな武器になります。

- 圧倒的なスピードでアイデアを具現化できる

- 面倒なルーチンワークから解放される

- 検証と改善のサイクルが従来の数倍速くなる

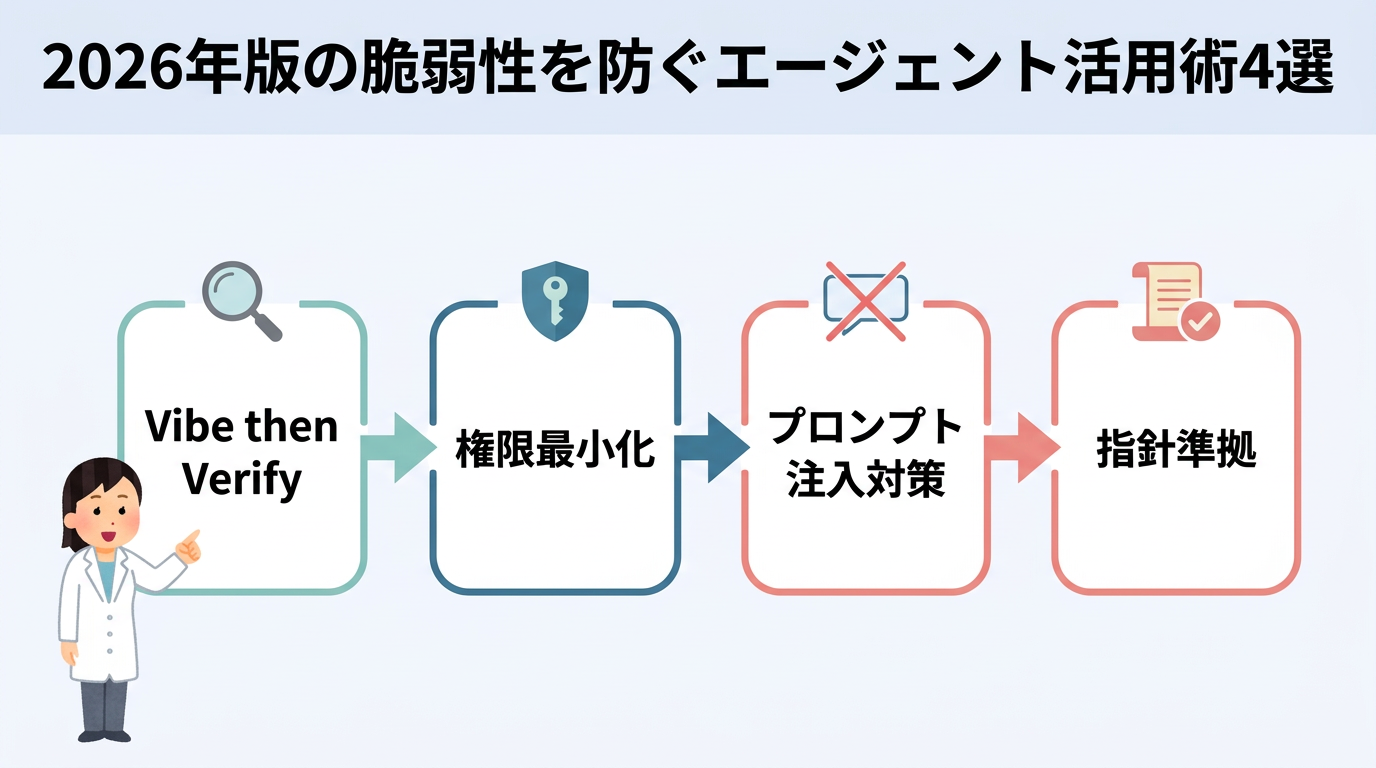

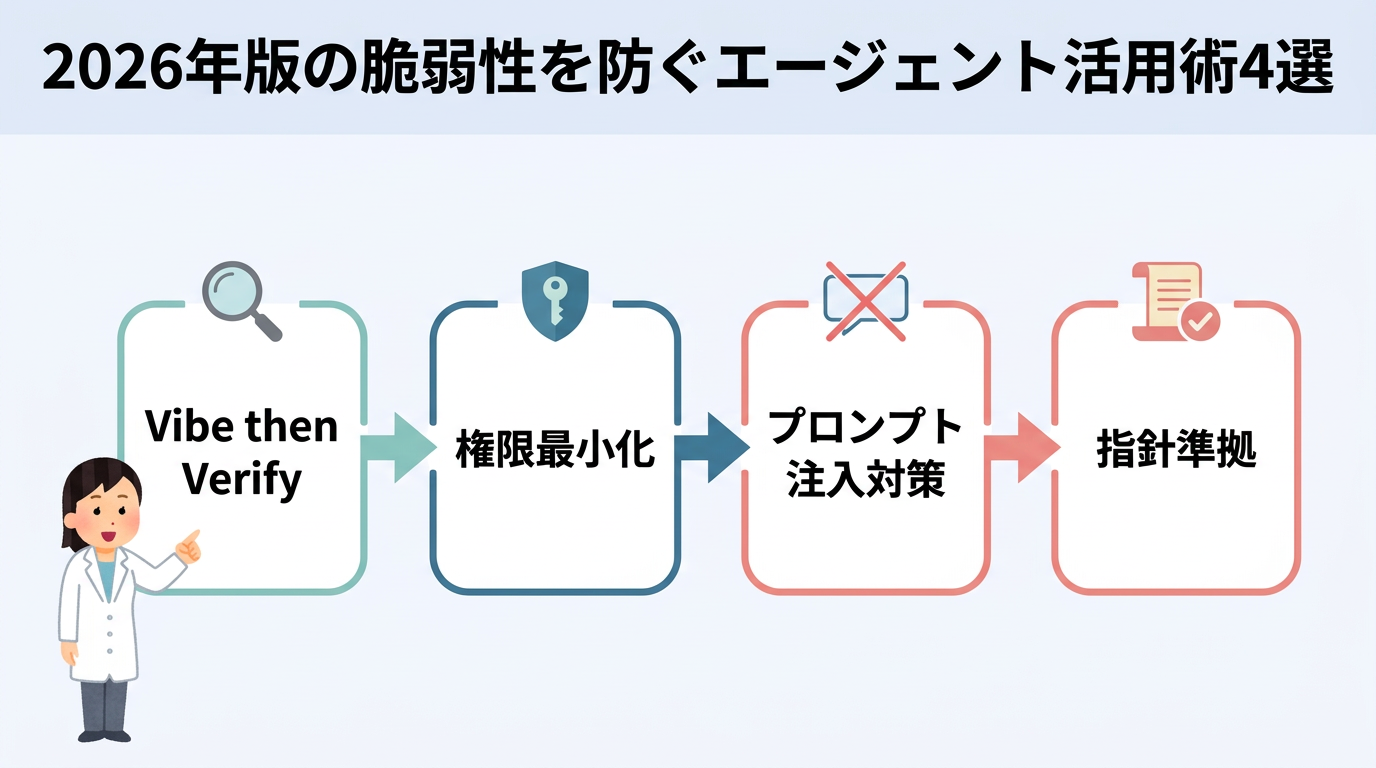

2026年版の脆弱性を防ぐエージェント活用術4選

「Vibe then Verify」が合言葉!

これだけで安全性がグッと高まります。

①Vibe then Verifyの徹底

2026年の合言葉は、雰囲気で作った後に必ず検証する「Vibe then Verify」です。

AIが生成したコードをそのまま信じるのではなく、必ず人間が内容を確認し、テストを通すことを徹底しましょう。

特に、diff(差分)を確認せずに「Accept All」するのは、セキュリティの観点からはガチでNG行為です。

「AIは間違えるもの」という前提で、最後に人間がハンコを押すプロセスを忘れないでくださいね。

②エージェント権限の最小化

AIエージェントに与える権限は、その作業に必要な範囲だけに絞るのが鉄則です。

CursorなどのIDEを使う際も、フルアクセスを許可するのではなく、読み書きできるディレクトリを制限しましょう。

特にターミナルの実行権限は、慎重に設定しないと意図しないシステム変更を招くリスクがあります。

米国政府の基準であるFedRAMP Highに準拠したWindsurfのような、ガバナンス機能の強いツールを選ぶのも賢い選択です。

③セキュアなプロンプト注入対策

AIに悪意のある指示を紛れ込ませる「プロンプト注入」への対策も欠かせません。

外部から取り込んだデータや、出所の分からないMCP設定ファイルを安易にAIに読み込ませないようにしましょう。

2026年1月に発覚したCursorのRCE脆弱性(CVE-2026-22708)も、プロンプトを通じた環境操作が原因の一つでした。

信頼できないインプットに対しては、AIを介さず直接人間がチェックする仕組みが必要です。

④政府策定のAI事業者指針への準拠

2026年2月、総務省と経産省が「AI事業者ガイドライン」の更新案を公開しました。

ここにはAIエージェントの自律的リスクへの対策が明文化されており、企業はこの指針に沿った運用が求められています。

個人でバイブコーディングを楽しむ場合も、このガイドラインを参考にリスクベースアプローチを意識してみましょう。

「どこまでをAIに任せ、どこを人間が守るか」の境界線を明確にすることが、2026年流の安全な戦い方です。

【Tips】「AI事業者ガイドライン」は、安全なAI活用のための公式な教科書です。

総務省・経済産業省の公式サイトで最新情報をチェックしておくと、プロフェッショナルな視点が身につきますよ!

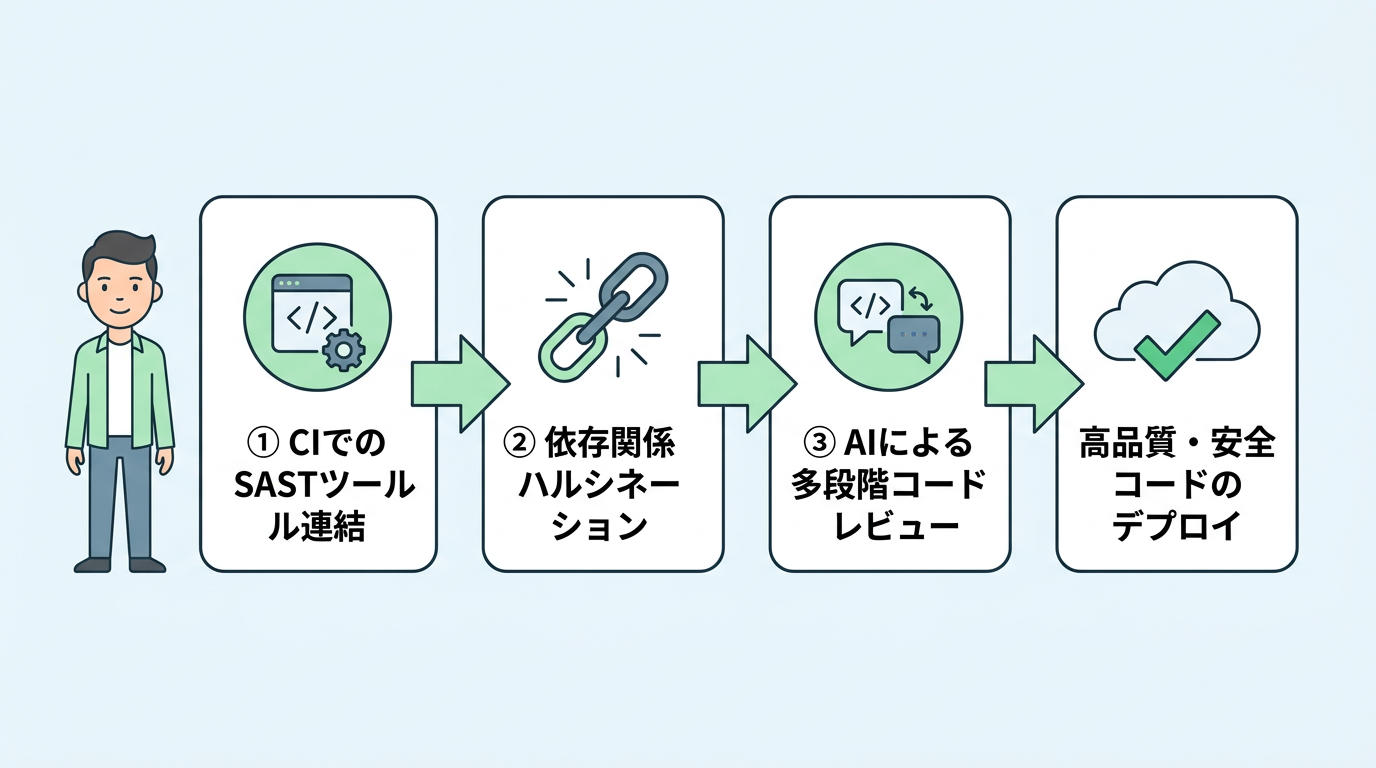

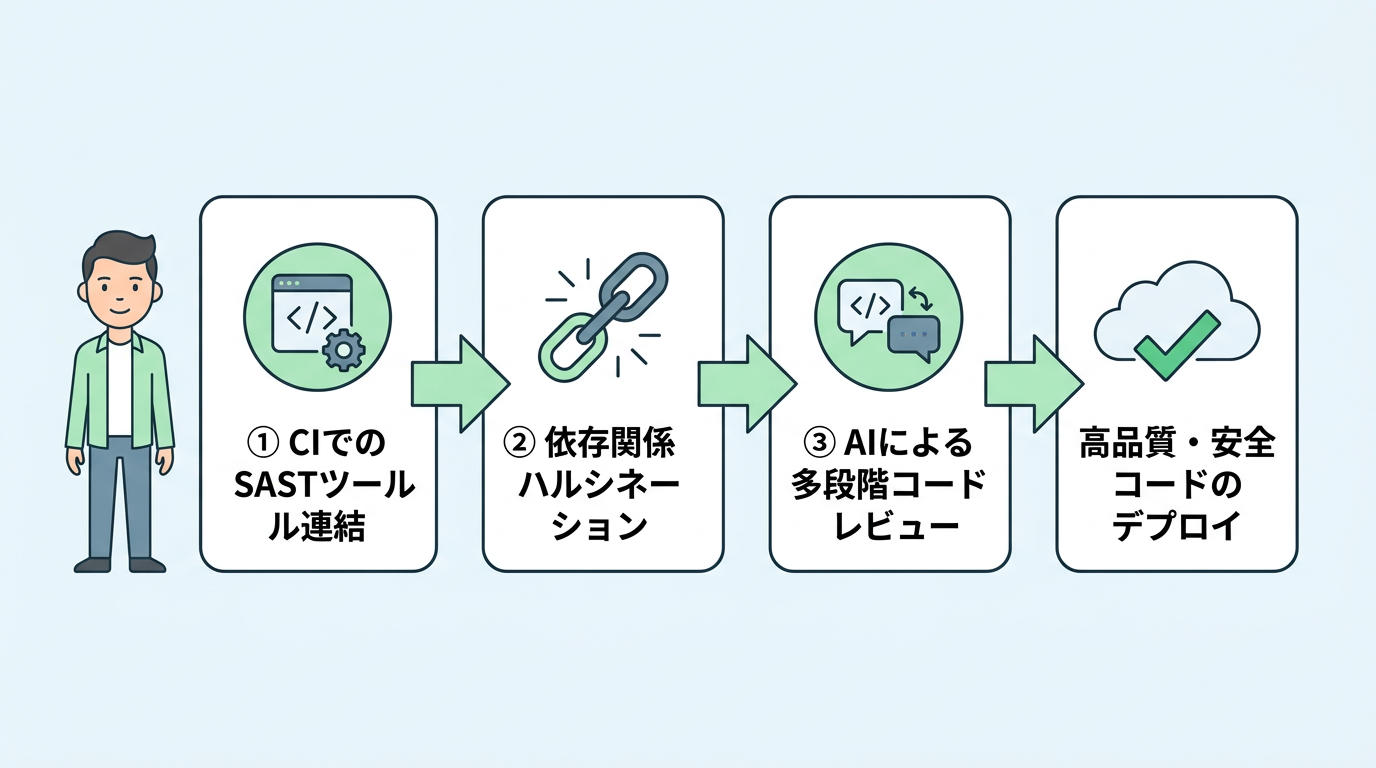

AI生成コードの品質を担保する自動化フロー3選

人間が全部やるのは無理。だからこそ、AIにはAIをぶつけましょう!

①CIでのSASTツール連結

バイブコーディングで書いたコードは、GitHub ActionsなどのCI(継続的インテグレーション)で自動スキャンしましょう。

SAST(静的解析)ツールを使えば、コード内の脆弱性をデプロイ前に自動で検知してくれます。

Veracodeの分析では、生成コードの45%にセキュリティ欠陥があるため、この自動チェックは必須と言えます。

人間が見逃すような細かいバグも、機械なら一瞬で見つけ出してくれるのでめっちゃ心強いですよ。

【用語解説】SAST(Static Application Security Testing)とは、プログラムを実行せずにソースコードを解析して、セキュリティの脆弱性を見つけ出す手法のことです。

②依存関係のハルシネーションチェック

AIが提案してきたライブラリが本当に存在するか、そして安全かを自動で検証するフローを導入しましょう。

npmやPyPIなどの公式レジストリと照合し、存在しないパッケージやスコアの低い怪しいパッケージを弾く仕組みです。

最近では、AI自身が「このライブラリは安全か?」

をインターネット検索して裏取りしてくれる機能も増えています。

「AIのハルシネーションをAIが監視する」という二重構造を作るのが、今のトレンドですね。

③AIによる多段階の相互コードレビュー

一人のAIが書いたコードを、別の役割(ペルソナ)を与えたAIにレビューさせるのも超絶有効です。

例えば、「あなたは厳しいセキュリティ監査官です。

このコードの脆弱性を5つ指摘してください」といった具合です。

技術ブログ「Zenn」などのコミュニティでも、この多段階レビューによる品質向上の事例が数多く報告されています。

複数のAIの視点を通すことで、単発の生成では気づけなかった論理的な欠陥が浮き彫りになります。

- CI/CDパイプラインにセキュリティスキャンを組み込む

- AIが提案する外部ライブラリを自動で名寄せ・検証する

- 役割の異なるAIを使い、生成コードを「相互レビュー」させる

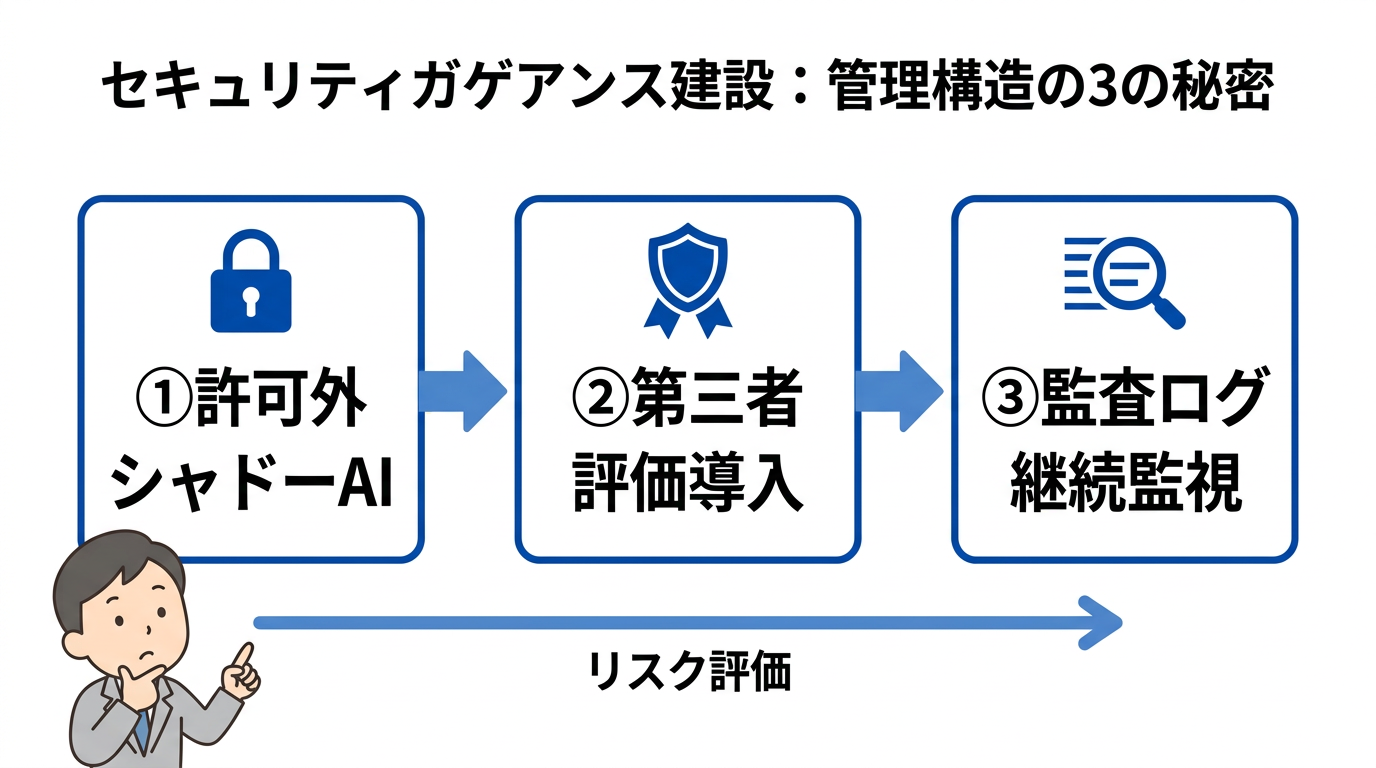

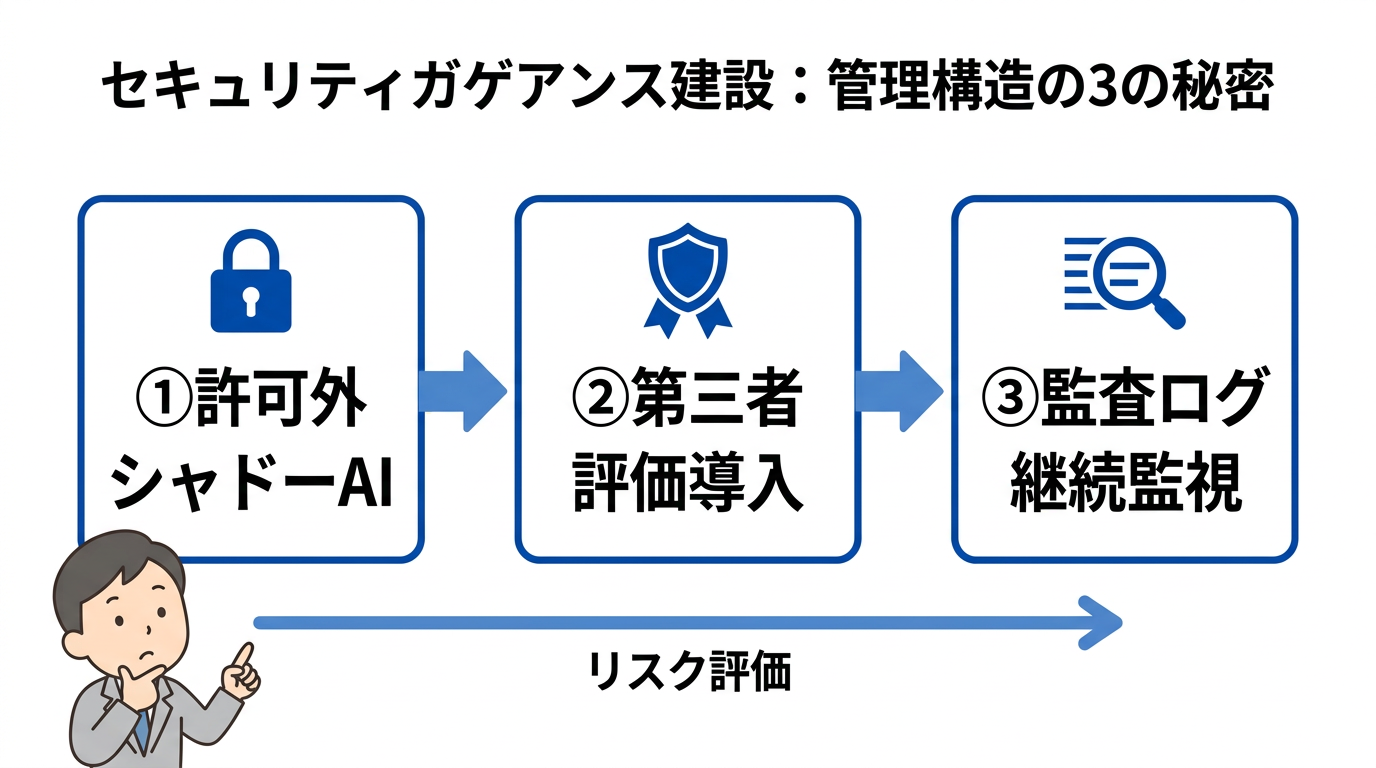

セキュリティガバナンスを構築する管理体制3つの秘訣

最後はやっぱり「人の管理」が大事。組織で守る体制を作りましょう!

①許可外のシャドーAI対策の徹底

従業員が勝手に個人アカウントのAIエージェントを使う「シャドーAI」は、企業にとって大きなリスクです。

Furious Green合同会社のガイドによれば、高度な権限を持つエージェントによる情報漏洩への警戒が強まっています。

まずは組織で使用を許可するツールを明確にし、必要であればエンタープライズ版を導入して管理下に置きましょう。

「ダメ」と禁止するのではなく、「安全な場所」を会社が提供するのが今の正解です。

②JC-STAR等による第三者評価導入

自社のセキュリティが本当に大丈夫か不安なら、公的な評価制度を活用するのも手です。

デジタル庁や経産省が推進する「JC-STAR(日本クラウドサービス・セキュリティ評価制度)」などが本格運用されています。

サプライチェーン全体を対象とした評価を受けることで、対外的にも「うちは安全にAIを使いこなしてます」とアピールできます。

公的なお墨付きを得ることは、2026年のビジネスシーンで信頼を勝ち取るための強力な武器になりますよ。

【用語解説】JC-STAR(Japanese Cloud Security Trust and Assurance Report)とは、日本のクラウドサービスのセキュリティを客観的に評価し、信頼性を可視化するための制度です。

③エージェントの監査ログ継続監視

AIエージェントが「いつ」「誰が」「どんな指示を出して」「何を操作したか」のログを常に残しておきましょう。

Windsurfのように監査ログ機能が強化されたツールを使うことで、万が一の事態が起きた際も原因究明がスムーズになります。

「誰かが監視している」という体制があるだけで、不適切な利用(社外秘データの入力など)の抑止力にもなりますよね。

ログを定期的に見返すことで、AI活用の改善点も見えてくるので一石二鳥です!

| 対策項目 | 具体的なアクション | 期待できる効果 |

|---|---|---|

| ツール管理 | 認可済AIツールのみを使用許可 | シャドーAIによる情報漏洩防止 |

| 技術的対策 | CI/CDにSASTツールを連結 | 脆弱性のあるコードの流出阻止 |

| 体制整備 | JC-STAR等の評価制度を活用 | 組織全体のセキュリティレベル向上 |

まとめ:バイブスだけで終わらせない!安全な開発を

バイブコーディングは直感でアプリが作れる最高の体験ですが、2026年の今、セキュリティを無視するのはガチで危険です!

「動けばOK」の先にあるリスクをしっかり押さえて、安全に爆速開発を楽しみましょう。

今回のポイントをサクッとおさらいです!

- AI生成コードの約40%には脆弱性がある!最後は人間の目で「ダブルチェック」が鉄則です

- APIキーなどの機密情報は絶対に直書きNG!スキャンツールをフル活用しましょう

- 存在しないライブラリを信じないで!「AIパッケージ・ハルシネーション」は常に警戒を

- MCPプロトコルなどの最新機能を使う時こそ、権限設定を最小限に絞るのがコツ!

まずは今日から、GitHubにプッシュする前に「秘密の情報が混じってないか?」

を確認する習慣をつけてみてください。

安全な基盤があってこそ、あなたのバイブスは最大限に発揮されますよ!

ぜひ、リスクを賢く回避してクリエイティブな開発を楽しんでくださいね。

登録特典(GPTs・プロンプト作成方法が分かる動画)あり、そのほかAIツールやプロンプトのプレゼントもあったり、登録するだけで「お得」なメルマガです。

コメント