「AIに任せればOK!」

ってノリで開発しちゃうバイブコーディング、最近マジで流行ってますよね。

でも、実は怖いデメリットが隠れているって知ってました?

「動けばいいや」で進めると、ガチで深刻なセキュリティリスクや効率低下を招くことも…。

この記事では、バイブコーディングのデメリット5選と回避策をサクッと解説します!

AIと楽しく、かつ安全に付き合うコツを一緒にチェックしていきましょう!

バイブコーディングの深刻なデメリット5つ

ヒナキラ

ヒナキラAI任せはマジで危険!あとで泣かないために、リスクをしっかり把握しましょうね。

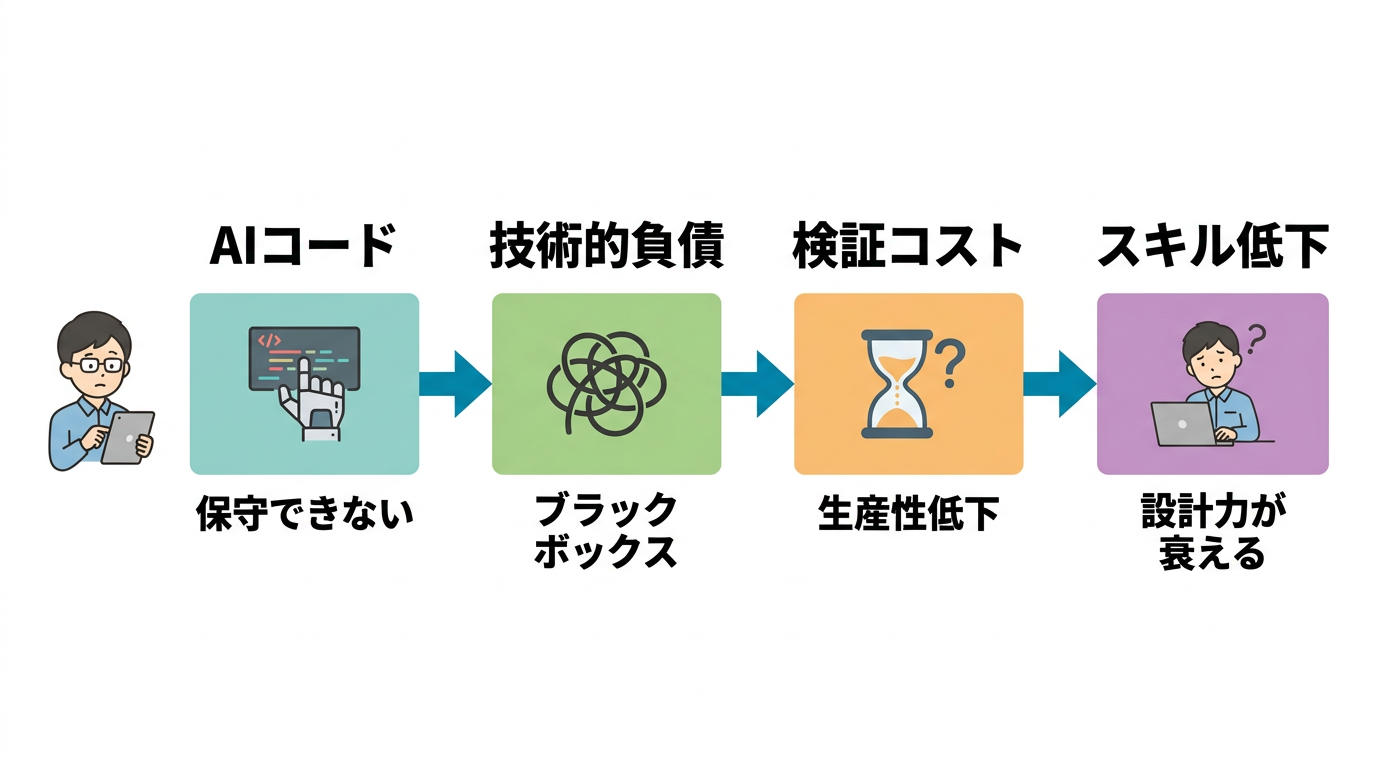

①技術的負債2.0による保守性の欠如

バイブコーディングの最大のリスクは、将来の自分が苦しむ「技術的負債2.0」を爆速で積み上げてしまうことです。

AIは指示に対してコードを出力しますが、プロジェクト全体の整合性や長期的なメンテナンス性までは完璧に考慮してくれません。

実際に2億行以上のコードを解析した調査によると、AI導入後は「コピー&ペースト」による重複コードが2022年比で約10倍に急増しているというデータもあります。

場当たり的なコードが増え続けることで、数ヶ月後には誰も触れない「スパゲッティコードの山」が完成してしまうわけです。

まさに、今の「楽」が将来の「地獄」を招く構造と言えますね。

【用語解説】技術的負債2.0とは、AIによって人間が理解できないレベルの速度と量で蓄積される、質の低いコードや設計の不備のことです。

②中身が不明なコードのブラックボックス化

「動けばOK」というノリでAIが生成したコードをコピペし続けると、システムの中身が誰にも分からないブラックボックスになります。

開発者本人が「なぜこのコードで動いているのか」を説明できない状態は、エンジニアとしてマジでヤバい状況です。

NTTデータが2026年1月に発表したレポートでも、このブラックボックス化がシステムの透明性を損なうと強く警告されています。

いざトラブルが発生したときに、原因箇所を特定できず、修正にも膨大な時間がかかるという最悪のシナリオが待っています。

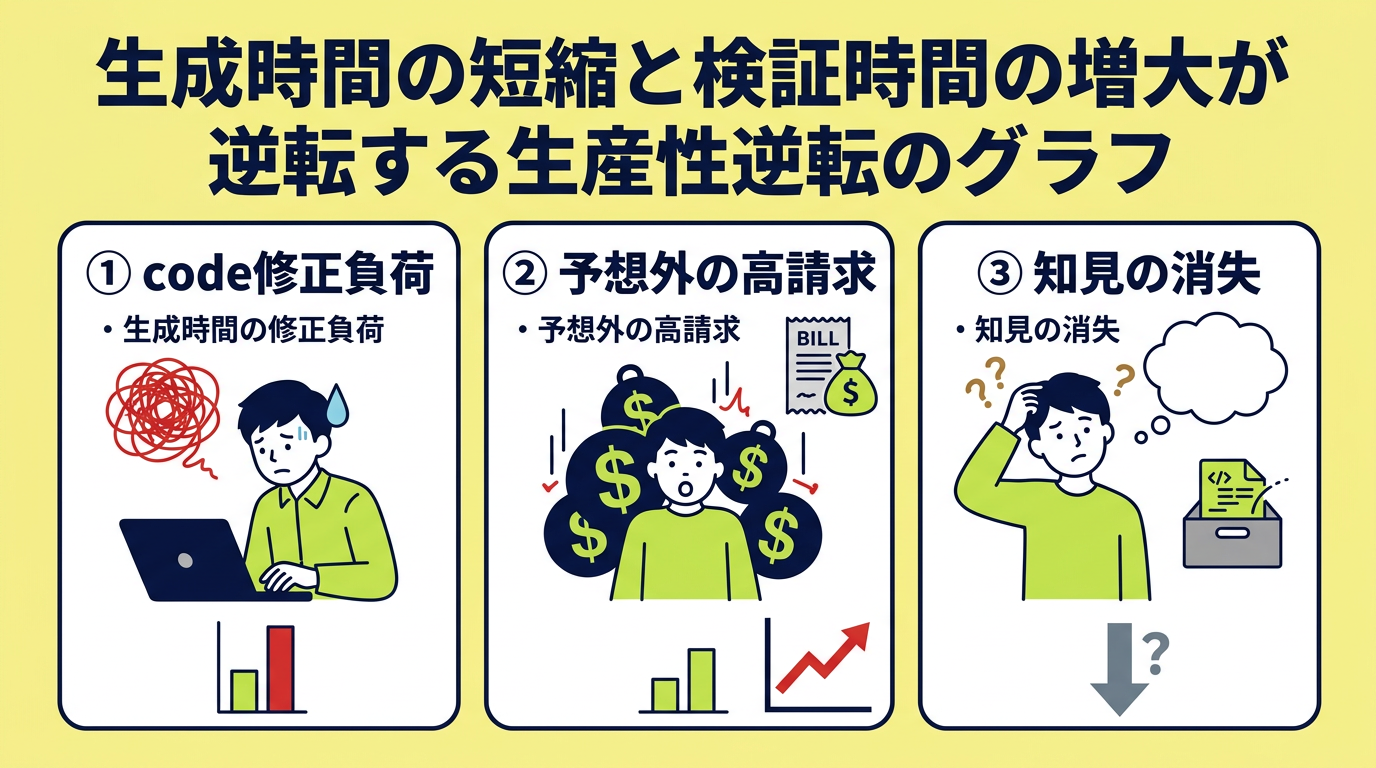

③検証コスト増大による生産性の逆転

「AIを使えば爆速!」

と思われがちですが、実は検証コストが生成速度を上回ってしまう「生産性のパラドックス」が起きています。

2026年の最新調査では、AI生成コードは体感で20%速く感じても、実際はメンテナンス負荷で全体の完了時間が19%遅れているという衝撃の結果が出ています。

AIが書いた「ほぼ合っているけど、微妙にバグっているコード」のデバッグは、自分で書くよりもはるかに精神を削られる作業です。

結局、AIが1秒で作ったコードのミスを、人間が30分かけて直すといった本末転倒な事態が現場で頻発しています。

④エンジニアの基礎設計力と読解力の低下

AIに頼りすぎるバイブコーディングは、エンジニアとしての基礎体力を奪う「スキルの空洞化」を招きます。

公式ドキュメントを読み込み、アルゴリズムを自分の頭で考える機会が減ることで、応用力がガチで落ちてしまうんです。

実際、研究者の間では開発者がドキュメントを訪れる機会が40%も減少しており、OSSエコシステムの崩壊すら懸念されています。

AIが使えない環境になったとき、あるいはAIが解決できない難問に直面したとき、何もできないエンジニアになってしまうのは恐怖でしかありません。

関連記事:バイブコーディングとは?意味やCursor実践法、AI時代の生存戦略を徹底解説

⑤デバッグ地獄を招くAIの幻覚問題

AIは平気で「存在しないライブラリ」や「間違った関数」を、もっともらしく提案してくることがあります。

これがいわゆる「幻覚(ハルシネーション)」ですが、これに気づかず実装を進めると、深夜のデバッグ地獄が確定します。

技術誌『Software Design』2026年2月号でも、理解不足によるデバッグ地獄がバイブコーディング最大のデメリットとして特集されました。

「雰囲気」でコードを生成するスタイルの限界は、まさにこの「正確性の欠如」にあると言っても過言ではありません。

潜むセキュリティリスクと攻撃手法3選

「自分は大丈夫」という過信が一番危ない!最新の攻撃手法を知っておこう。

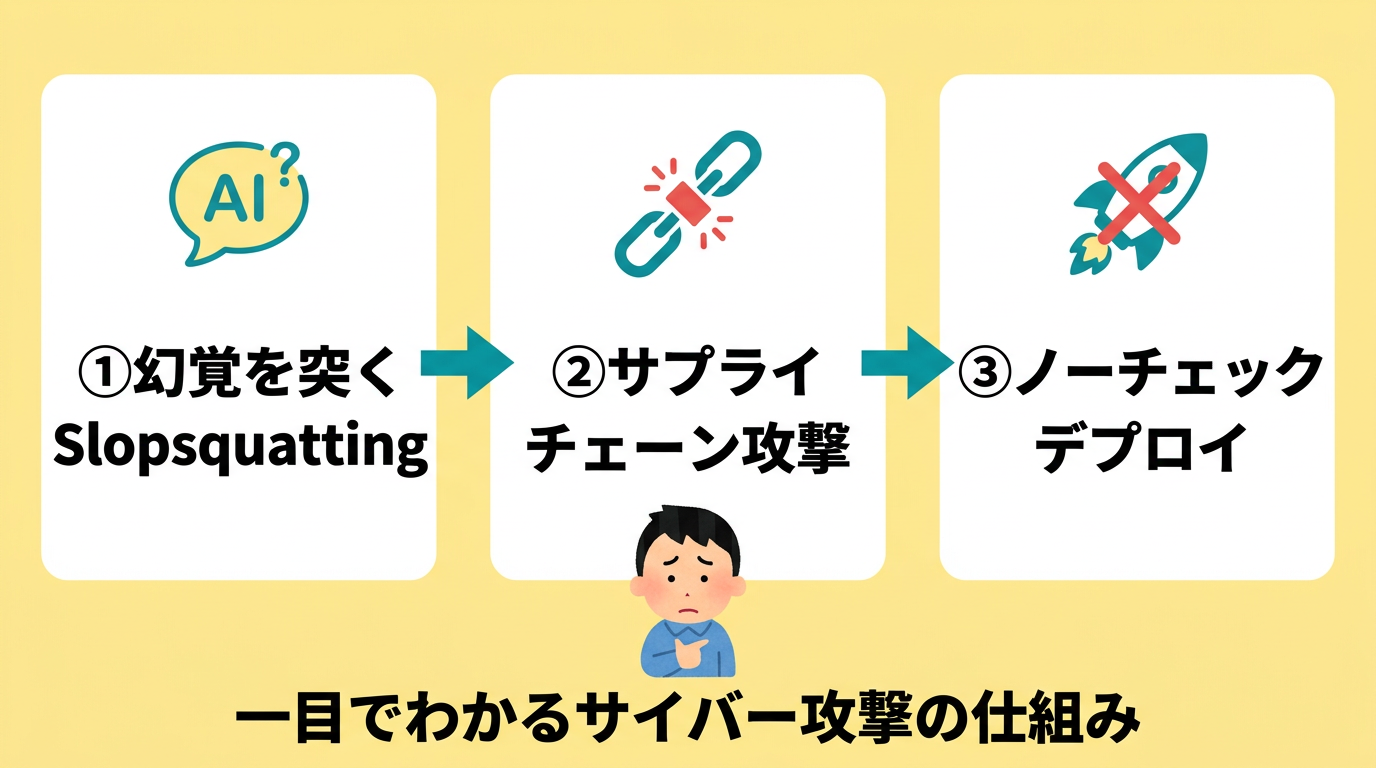

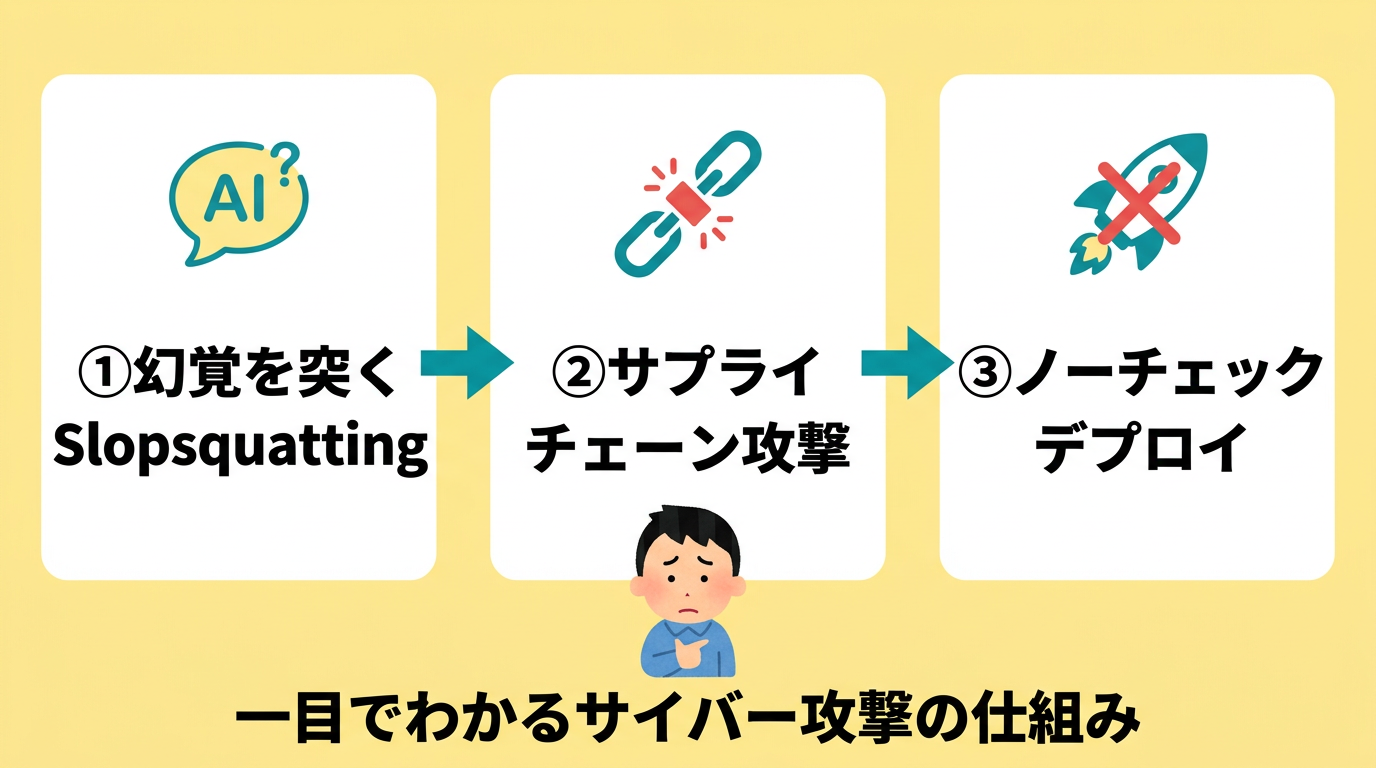

①幻覚を突く新手法Slopsquatting

2026年に入り、AIの幻覚を逆手に取った「Slopsquatting」という超絶悪質な攻撃が急増しています。

これは、AIが提案しがちな「実在しないパッケージ名」を先回りして攻撃者が登録し、ウイルスを仕込む手法です。

開発者がAIの提案を鵜呑みにして「npm install」した瞬間、機密情報が盗まれるというマジで怖い事件が報告されています。

AIの提案するコードに「未知のライブラリ」が含まれていないか、常に疑う姿勢が絶対に必要です。

【用語解説】Slopsquattingとは、AIが生成する偽のライブラリ名(ハルシネーション)と同じ名前の悪意あるパッケージを公開し、開発者にインストールさせる攻撃手法です。

②依存関係を悪用するサプライチェーン攻撃

AIは利便性を優先して、脆弱性のある古いバージョンのライブラリを提案することがよくあります。

2026年2月のBSIMM16レポートによると、AI生成コードの約45%に何らかの脆弱性が含まれているという衝撃のデータがあります。

気づかないうちに「穴」だらけのコードを本番環境にデプロイしてしまい、企業の信頼を失墜させるリスクがあるんです。

サプライチェーン(供給網)のどこにリスクが潜んでいるか、AI任せでは決して見抜くことはできません。

③脆弱性が放置されるノーチェックデプロイ

「AIが書いたんだから大丈夫でしょ」という心理的な油断(オートメーション・バイアス)が、最大のリスクかもしれません。

スタンフォード大学の研究では、AIアシスタントを使う開発者ほど、自分のコードを「安全だ」と過信する傾向が確認されています。

実際には脆弱性が含まれているのに、人間によるコードレビューをスキップしてデプロイしてしまうケースが後を絶ちません。

AIはあくまで「提案者」であり、セキュリティの最終責任は人間にあることを忘れてはいけませんね。

- 脆弱性の混入率:約45%(Veracode調査)

- ソフトウェア欠陥の増加予測:2028年までに2500%増(Gartner)

- デリバリー安定性の低下:7.2%減(Google DORAレポート)

開発効率が逆に低下する3つの落とし穴

時短のはずが残業増…なんて悲劇は避けたいところ。落とし穴に注意!

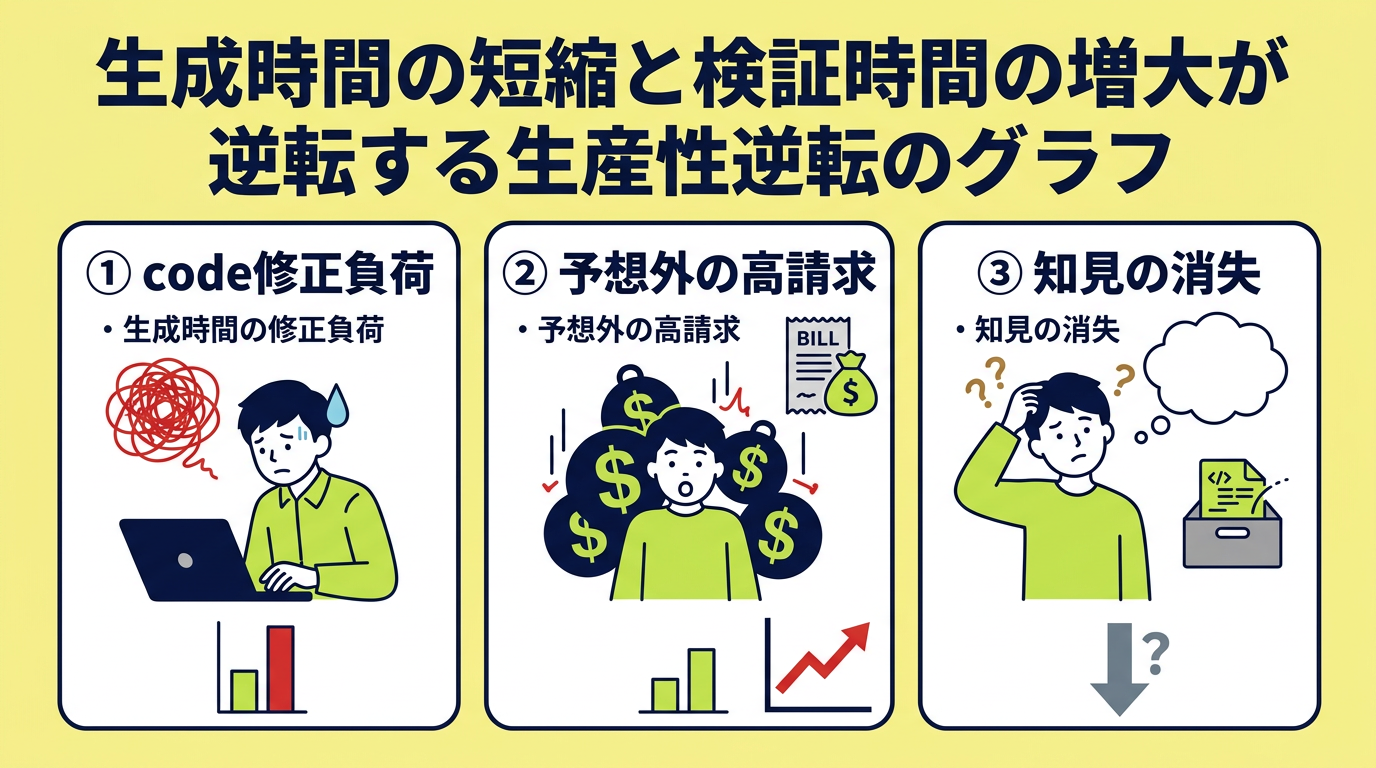

①「ほぼ正しい」コードの修正に伴う負荷

AIが生成するコードは「8割正解」であることが多く、残りの2割を直す作業にめちゃくちゃ時間がかかります。

この「微妙な間違い」を探す作業は、ゼロから自分で書くよりも認知的な負荷が高く、エンジニアを疲弊させます。

Stack Overflowの2025年調査では、45%の開発者が「AIコードのデバッグは自分で書くより時間がかかる」と回答しているんです。

まさに、サクッと終わるはずが、泥沼にはまって抜け出せなくなる「時短の罠」ですね。

②試行錯誤の連続による予想外の高額請求

最近のAIツールは、高度なタスクをこなす代わりに「従量課金」を採用するケースが増えています。

例えば2026年2月に登場したReplit Agent 3などは、タスクの複雑さに応じた「努力ベース価格」を導入しています。

「バイブス」で何度も修正を繰り返していると、月の利用料が数万〜数十万円という高額請求に化けるリスクがあります。

効率化のために使っているツールで、コストだけが爆増しては元も子もありません。

| 項目 | 従来のコーディング | バイブコーディング |

|---|---|---|

| 初期作成スピード | 遅い(手動) | 爆速(AI生成) |

| 修正・デバッグ時間 | 短い(把握済み) | 長い(中身が不明) |

| ツールコスト | 固定(エディタ代等) | 変動(AI API利用料) |

| 長期保守コスト | 低い(設計重視) | 高い(負債蓄積) |

③OSSエコシステムへの貢献と知見の消失

AIに答えを聞き続けることで、私たちはオープンソース(OSS)のコミュニティから遠ざかっています。

誰かが書いた公式ドキュメントやStack Overflowの議論を読まなくなることで、知見が循環しなくなっているんです。

これにより、バグ報告やライブラリの改善提案といった「コミュニティへの恩返し」が途絶え、エコシステム全体が弱体化しています。

自分たちを支えてくれている技術基盤が「静かに崩壊」していくのは、長期的に見て大きな損失でしかありません。

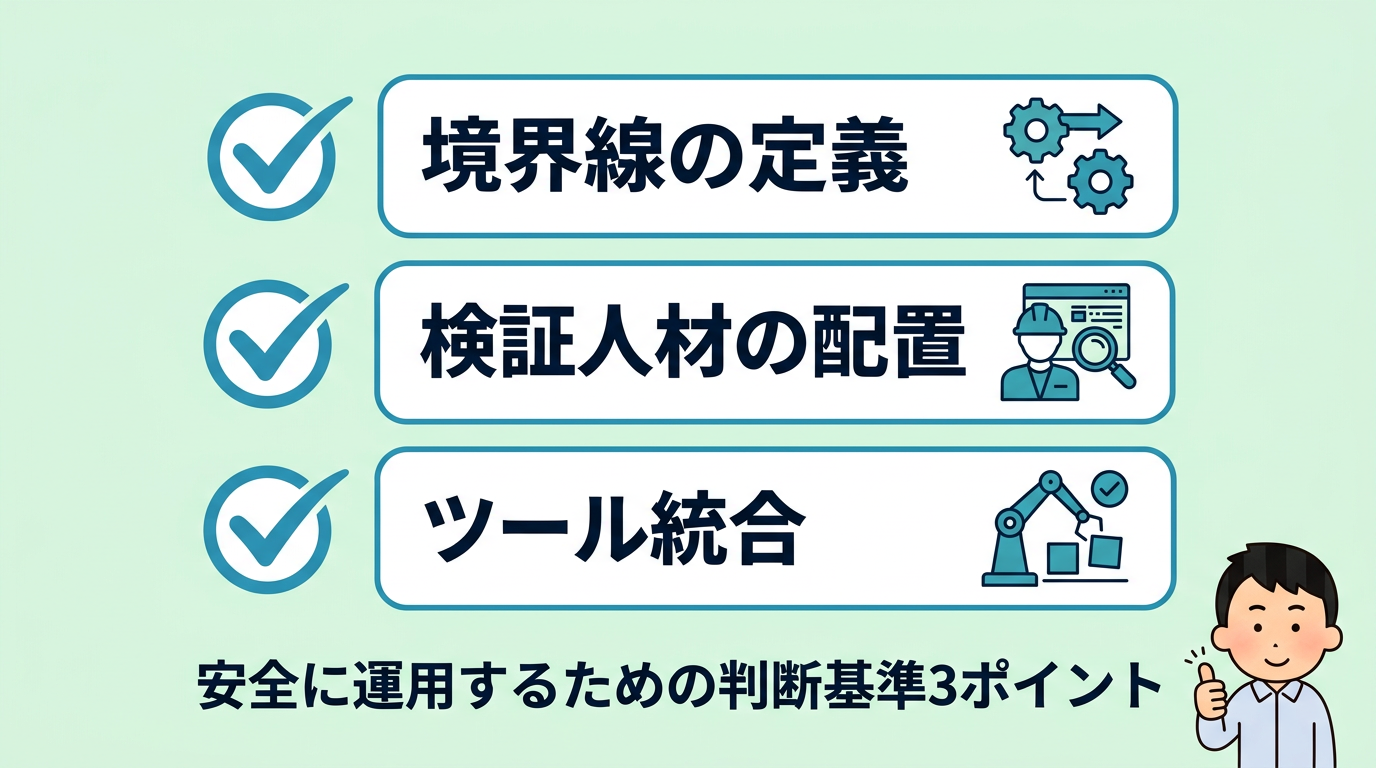

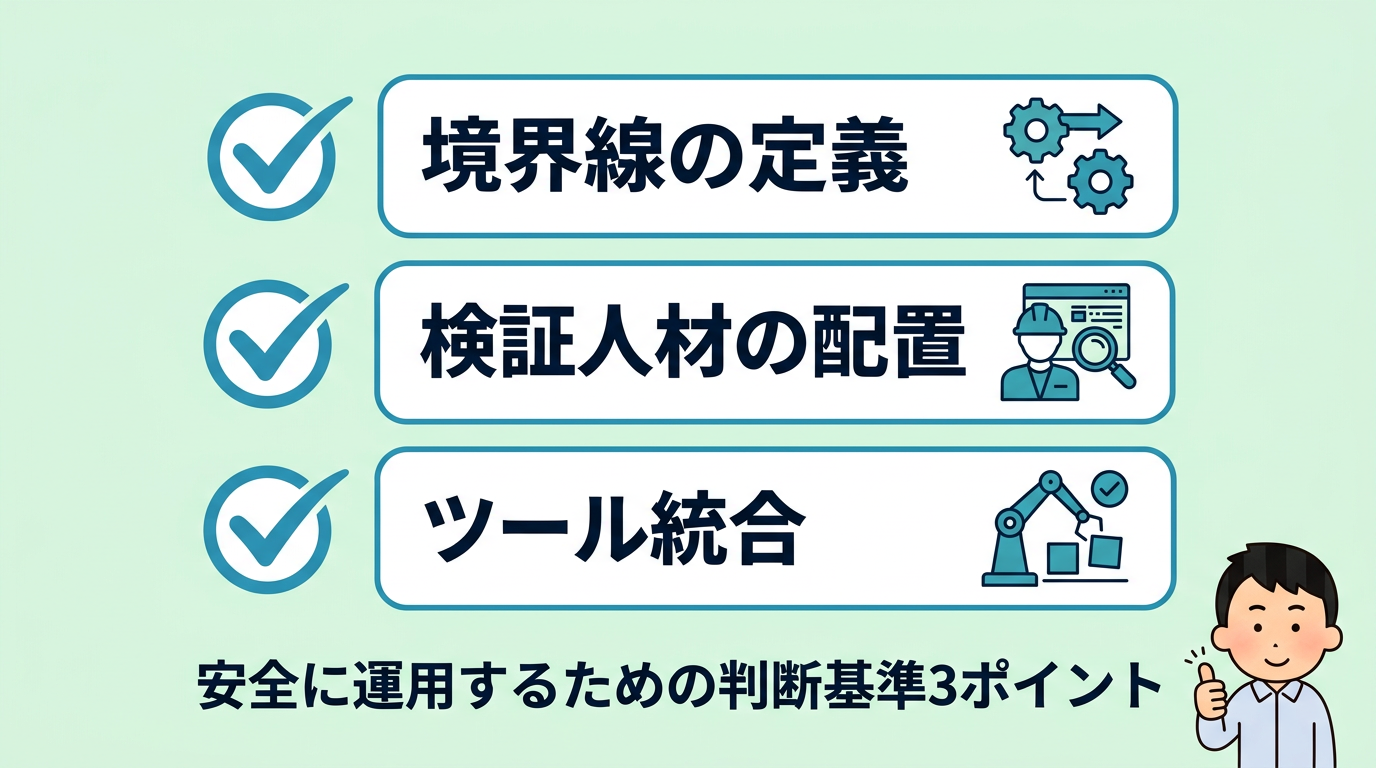

安全に運用するための判断基準3ポイント

リスクを知った上で、どう使うかが腕の見せ所!賢い運用ルールを作りましょう。

①プロトタイプと本番運用の境界線定義

まず大切なのは、「とりあえず動くものを作る」段階と「本番に出す」段階をハッキリ分けることです。

個人の検証用やプロトタイプならバイブコーディングで突き進むのもアリですが、本番環境では絶対にルールを変えるべきです。

「本番用コードには必ず人間が1行ずつレビューを入れる」という境界線を引くだけで、リスクは激減します。

ワクワクする開発速度を楽しみつつも、リリース前のブレーキは忘れずに持っておきましょう。

②AIを検証・監査する専門人材の配置

これからの時代、AIにコードを書かせる人だけでなく、AIが出した結果を「監査」する人が重要になります。

NTTデータも提唱しているように、AIを監視する「Architect & Auditor」人材の育成が急務です。

ただコードが書けるだけでなく、セキュリティやアーキテクチャの深い知識を持ってAIを統制する役割ですね。

チームの中に「AIポリス」的な役割を置くことで、品質の低下を未然に防ぐことができます。

③自動スキャンツールのCIパイプライン統合

人間の目だけに頼るのではなく、機械的にセキュリティチェックを行う仕組みを強制的に導入しましょう。

SAST(静的解析)やSCA(ソフトウェア組成解析)といったツールを、開発フロー(CI/CD)に組み込むのが鉄則です。

AIが生成したコードに脆弱性や未許可のライブラリが含まれていないか、自動でスキャンしてアラートを出すようにします。

「仕組み」で安全を担保することで、開発者は安心してAIのパワーを活用できるようになります。

- 人間による徹底レビュー: どんなにAIを信じても最後は「人の目」!

- 自動スキャンツール: 脆弱性やライセンス違反を機械的に検知!

- 厳格な設計ガイドライン: AIに守らせるべき「型」を定義!

2026年以降のエンジニアリング4指針

バイブコーディングの「先」へ。最新トレンドを取り入れて、一歩先の開発者へ!

①エージェンティック開発への管理シフト

2026年、バイブコーディングの提唱者であるアンドレイ・カルパシー氏ですら、「単なるノリでの開発は古い」と断言しました。

現在は、複数のAIエージェントに役割を与え、人間がそれを高度に統制する「エージェンティック・エンジニアリング」へと進化しています。

ただチャットに投げるのではなく、AIを「自律的な作業ユニット」として扱い、その進捗と品質を管理する能力が問われています。

「作る」から「オーケストレート(指揮)する」へのシフトが、これからの勝ち筋ですね。

【用語解説】エージェンティック・エンジニアリング(Agentic Engineering)とは、AIに目的を与え、自律的に思考・実行させる「AIエージェント」を人間が管理・統括する次世代の開発手法です。

②AIを下っ端料理人と見なす統制モデル

AIを万能な「シェフ」として崇めるのではなく、あくまで指示通りに動く「下っ端料理人」として扱うべきです。

レシピ(設計)を書くのはあくまで人間であり、AIはその下ごしらえを担当する、という主従関係を明確にします。

下っ端が作った料理に毒(脆弱性)が入っていないか、味付け(ロジック)が間違っていないか、シェフであるあなたが最終確認するのは当然ですよね?

この「人間主導モデル」こそが、AI時代の品質を守る最強のメンタリティです。

③公式ドキュメントを重視する回帰思考

AIブームが一周した今、改めて「公式ドキュメントを読む」という基本への回帰が進んでいます。

AIの要約は便利ですが、細かい仕様や最新のアップデート情報では公式に敵いません。

「AIに聞く前に1分だけドキュメントを見る」という習慣を持つだけで、ハルシネーションに騙される確率はグッと下がります。

泥臭い勉強こそが、AIを使いこなすための最大の近道であるという事実は、2026年になっても変わりません。

結局のところ、基礎があるエンジニアがAIを使うのが一番最強なんです。ガチで。

④AI時代のコードレビューチェックリスト

最後に、AI生成コードをチェックする際に必ず確認すべきポイントをまとめておきます。

これを意識するだけで、バイブコーディングのデメリットの多くを回避できるはずです。

- 実在確認: そのライブラリや関数は本当に実在するか?(Slopsquatting対策)

- 重複確認: 既存のコードと同じことを別の書き方でやっていないか?

- 例外処理: エラーが起きたときの処理が「AI任せ」で適当になっていないか?

- セキュリティ: 外部入力をそのままSQLやコマンドに渡していないか?

- 意図の理解: 自分はこのコードの1行ずつの意味を説明できるか?

AIの進化はハンパないですが、それを使いこなすのはあくまで「あなた」です。

デメリットを正しく恐れ、賢く対策することで、安全で楽しいAI開発ライフを送りましょう!

補足:AI活用による生産性の変化についてはGartnerによる2500%の欠陥増加予測も参考にしてみてください。

まとめ

いや〜、バイブコーディングって最初は「魔法かよ!」

って感動しちゃいますが、実はヤバい罠がたっぷり潜んでいるんですよね。

あとで自分が泣きを見ないために、今回お伝えしたリスクをしっかり整理しておきましょう!

- 爆速で積み上がる「技術的負債2.0」が将来の自分を苦しめる

- 内容を理解しないままのブラックボックス化は、トラブル時に詰む原因に

- デバッグや検証に時間がかかり、結局効率が落ちる「生産性の逆転」が起きる

- AI任せにすることで、エンジニアとしての基礎設計力や読解力がガタ落ちする

AIはあくまで「超優秀なアシスタント」です。

主導権はしっかり自分が握って、生成されたコードを一行ずつ吟味する癖をつけていきましょう!

まずは次の実装から、「なぜこのコードで動くのか?」

を自分の言葉で説明できるかチェックすることから始めてみてくださいね。

ガチでスキルアップに繋がりますよ!

登録特典(GPTs・プロンプト作成方法が分かる動画)あり、そのほかAIツールやプロンプトのプレゼントもあったり、登録するだけで「お得」なメルマガです。

コメント